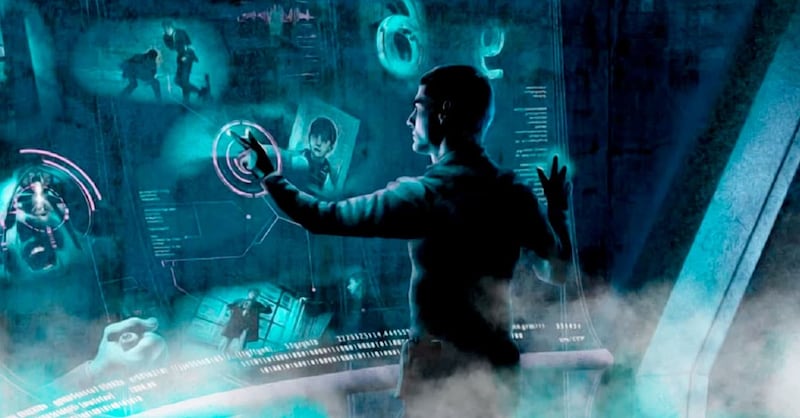

El rápido avance de la Inteligencia Artificial (IA) ha generado un nuevo y complejo desafío legal a nivel global: la protección del rostro y los datos biométricos. La capacidad de la IA para crear deepfakes y manipular o replicar la identidad de una persona de forma sencilla está obligando a los legisladores a actualizar los marcos regulatorios existentes. Esta situación ha sido descrita como “la próxima frontera legal” en la intersección entre tecnología y derechos fundamentales.

La amenaza a la identidad y el consentimiento

El problema central radica en que la IA hace trivial la manipulación o replicación del rostro de una persona, planteando complejas interrogantes sobre la privacidad, el consentimiento, la difamación y la definición misma de la identidad en el entorno digital.

- Vigilancia y Bases de Datos: Los datos faciales se integran cada vez más en sistemas de monitoreo masivo y pueden ser utilizados por actores privados y gubernamentales para fines no revelados o sin el consentimiento explícito del individuo.

- Irreversibilidad del Dato: A diferencia de una contraseña o un número de tarjeta de crédito, las características faciales son datos biométricos inmutables. Una vez que esta información sensible se ve comprometida, no puede ser cambiada, lo que eleva el riesgo de ciberseguridad y el daño potencial a la identidad.

- Sesgos Algorítmicos: La implementación de sistemas de reconocimiento facial con algoritmos sesgados puede generar errores de identificación, afectando desproporcionadamente a ciertos grupos poblacionales.

El desafío de la regulación y el caso de la Ley NO FAKES

La velocidad del desarrollo de la IA está superando la capacidad de respuesta de los procesos legales tradicionales. Diversos organismos y gobiernos han reaccionado a esta amenaza con nuevas propuestas normativas que buscan abordar las carencias legales actuales.

Un ejemplo de la dificultad regulatoria se observa en el debate sobre proyectos como el NO FAKES Act en Estados Unidos. Aunque esta ley busca proteger a los individuos de la replicación no autorizada de su voz e imagen, ha generado críticas de grupos de defensa de la libertad de expresión, quienes advierten que podría establecer una “nueva infraestructura de censura”. Estos grupos alegan que obligar a las plataformas a filtrar contenido de forma tan amplia podría llevar a eliminaciones accidentales y restringir el discurso legítimo en línea.

La discusión actual subraya la necesidad de encontrar un equilibrio legal que permita la innovación tecnológica sin comprometer los derechos fundamentales de las personas, siendo el rostro humano el activo más valioso a proteger en la era de la Inteligencia Artificial.

Tags

Source link